現実世界の環境や物体等をサイバー空間に再現する仕組みが発展しつつある。今日、撮像をデジタルデータとして取り込む際、撮影時の照明条件がAI解析の精度やユーザ体験の品質を大きく影響する。物体認識や自己位置推定では、同条件が推定精度に影響を与える――

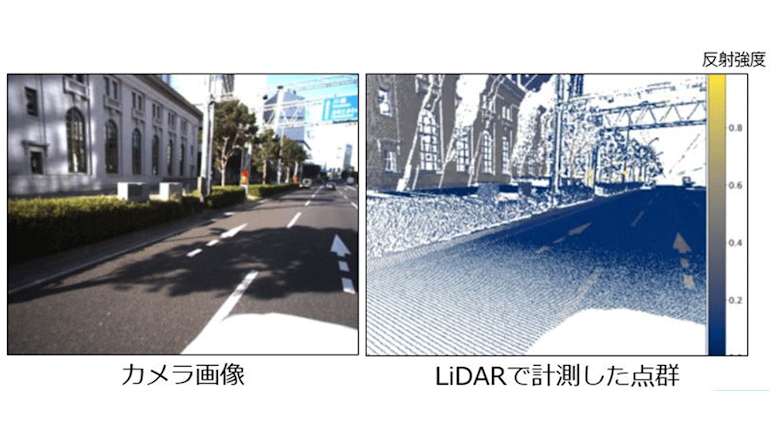

そのため様々な条件下で撮影した画像データを集めて検証する必要があった。また、メタバース空間の構築では、複数のデータを統合する際、多様な日照条件で計測したデータがツギハギになり、同空間に撮影時の影が残ってしまう問題があったという。NTTは、撮像から照明条件によらない「真の色」である物体固有のアルベド(反射率)を推定するタスクにおいて、LiDAR(光検出&測距)反射強度を用いた固有画像分解手法を確立した。

IOWN構想の実現に向けた技術創出に取り組んでいる同社が今回実現した、上記手法により、影などの照明条件に依存した成分を画像から取り除くことで、任意の照明条件を再現することが可能になる。照明条件によらない物体固有のアルベドが推定できる。物体認識において同条件の影響を排除し、より高精度に認識できる。メタバース空間構築において、影を排除し任意の日照条件を再現した空間が構築可能となる。

今般の技術では、太陽光の影響がないLiDARで計測した反射強度を利用することで、効率的な学習を実現した。LiDAR反射強度を併用することで日影とテクスチャを区別して学習でき、教師無し学習手法の中で最高精度を達成し、教師有り学習手法(正解となるアルベド情報が付与されたCG画像から学習する方法)と比較しても遜色ない精度を実現した。

今後も、更なる精度向上に向けた研究開発を推進していく予定である。上記新たな技術を画像認識やメタバース空間構築などにも適用することで、より高品質なサービスの確立に貢献するという。同社の研究成果は、国際会議CVPR2023に採択された。