脳の神経細胞網を模したニューラルネットワークは計算機で使われる数理モデルだ。そのなかでも多層構造にて深度の大きい学習を指す、ディープニューラルネットワーク(DNN)モデルを用いた機械学習は、画像認識、音声認識、言語処理、レコメンデーションなど、多彩な分野で活用されている。

昨今、エッジコンピューティングへの展開も急がれていて、自動車や産業機器、IoT機器など、さまざまな組込みシステムへの実装が進んでいる。DNNモデルは、その計算量が非常に大きいため、ハードウェアスペックが乏しい組込みシステムで実装する場合、対象のDNNモデルに「高速化・軽量化」といった手法を適用することが一般的だが、そうすれば推論精度が低下してしまう、従来手法には課題があったという。

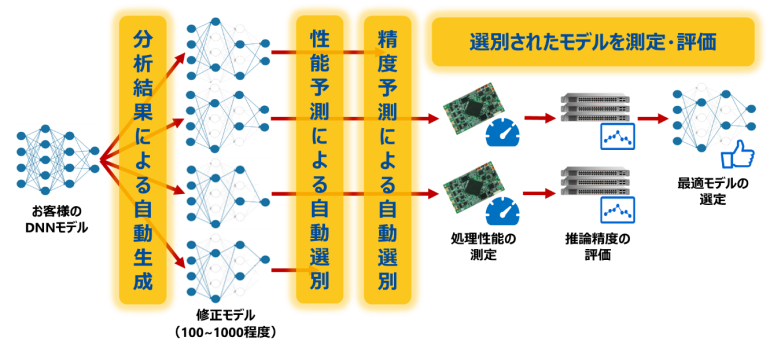

東芝情報システムは今月1日、精度維持と高速性を両立する「DNN高速化サービス」の提供を開始した。これは、顧客からDNNモデル、学習データ、精度評価指標などを預かり――自社の知見を活かして推論精度への影響が少なく処理性能を向上させた"修正モデル"の候補を大量に自動生成・自動選別し、有望モデルの性能測定と精度評価を実施――目標の処理性能・推論精度を満たすDNNモデルを提供するエンジニアリングサービスだ。

従来手法よりも低コスト・短期間で最適なDNNモデルを提供する。同社の「CVNucleus MonocularVisionソフトウェアライブラリ」のDNNモデルに適用したところ、推論精度を維持したまま処理性能を約5倍の113ミリ秒に短縮。リアルタイム処理を実現できた。サービス適用は1.5ヶ月で済んだという。

DNN高速化サービスについて、ハードウェアが非力な組込みシステムにおいてDNNモデルを実装する顧客に活用してもらうことを想定している。これにより同社は、製品開発の期間やコストの削減に寄与し、顧客の事業発展に貢献していく考えだ。