大変革の時代に、迅速かつ適切な意思決定を行う。企業は人工知能やデータを戦略的に活用する「AI経営」が求められている。一方で、AIの決定による各種インシデントや倫理違反、人種・性別等に依拠した差別的バイアス、プライバシーの侵害といったリスクを回避する取り組みが必須となっている。

今年に入り、EUがリスクベースのAI規制枠組案を提示し、米国FTCがAI規制による摘発を開始。法規制の強化が活発化している。各国政府もAIリスクを制御し、AIアルゴリズムに説明責任を負わせるための法的枠組みの構築に着手していて、日本でも政府による議論(人間中心のAI社会原則検討会議)が進んでいる。

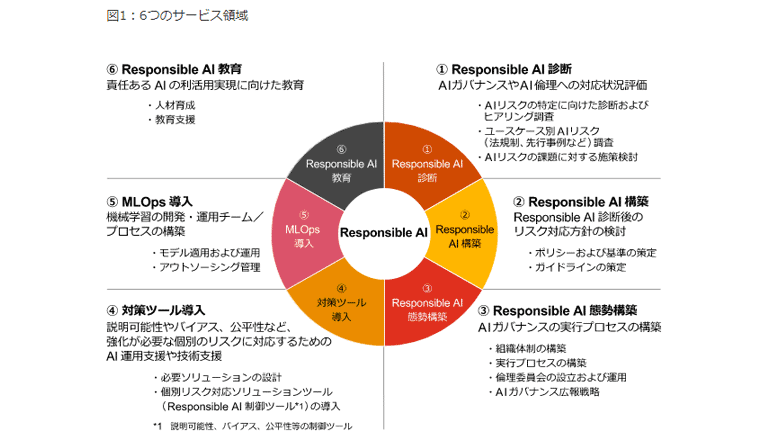

そのような背景の下、企業には、上記リスクの十分な理解およびAIの信頼性と説明可能性の担保が必要とされている。リスクを適切に制御したうえでAI利活用による効果を最大化する、AIガバナンスの態勢構築が喫緊の課題だという。PwCコンサルティングは、DXやAI開発・利活用を進める企業が、社会に対して倫理的で公平かつ安全な責任あるAIシステムを活用することを支援する「Responsible AI導入サービス」を今月14日より提供する。

Responsible AI診断にて、AIの開発および利活用に関わる6つのリスクを軸に、クライアント企業の組織上の課題から個別のユースケース別課題まで幅広くAIリスクを特定し、企業のAI利活用やAIガバナンスへの取り組み状況に応じた施策を検討する。AIの開発や利活用のライフサイクルに応じて、リスクへの対応だけでなく、技術的側面や法規制の動向、AIガバナンスの先行事例を踏まえたサービスを提供する。

同社は、今回のサービスを通じて、企業の倫理的で公平かつ安全なAIシステムの開発・導入、そして活用拡大を支援することで、AIがさらに社会やビジネス界に浸透し、責任ある方法で活用されることを目指すという。