情報通信

人に対する評価の公平性を保つAIの実現に向けて

AI・機械学習(ML)技術の発展がめざましい。近年、銀行の融資承認、企業の人材採用、児童に対する虐待の検知などをML予測を用いて行い、コスト低減や意思決定の効率化・高速化を目指す事例が増えつつある。

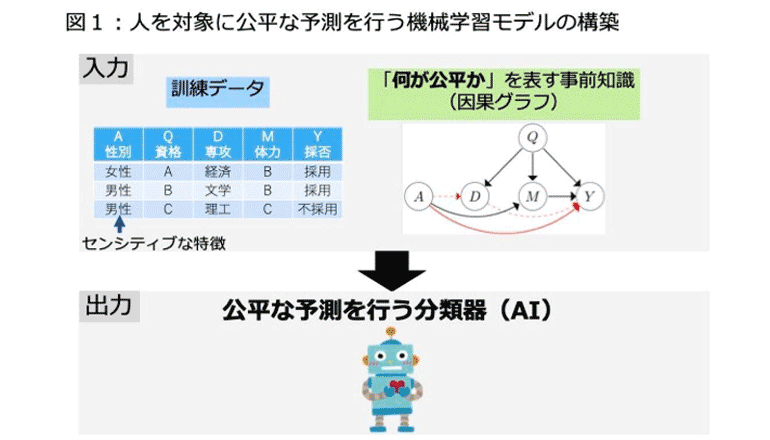

人を対象とした予測において、精度のみを優先するMLを適用すると、性別・人種・障がいなど、センシティブな特徴に関して不公平な予測を行うモデルになりかねない。一方で、どのような予測が不公平であるかは、個々の応用事例における要請によって異なることが多く、例えば「体力を要する職種における人材採用なので、体力の不足を理由とした不採用は不公平ではないと考えたい」というような要請も考えられる。

それを考慮しない技術を用いると、体力不足の応募者を多く採用してしまい、非効果的な意思決定となる。公平性に関する社会的要請を、特徴・予測結果間の関係を表す因果グラフにして、予測精度を向上させるML技術が複数提案された――これら従来技術は、特定モデル由来のデータ、単純な関数形で表現できるようなデータを用いた場合にしか予測の公平性を保証できないという。

NTTは、因果関係に基づく公平・高精度な機械学習技術を実現した。同技術では、不公平さに関する事前知識を因果グラフとして表現し、これを活用することで公平かつ高精度な機械学習予測を行う。様々なデータを用いて、公平な予測を行えることを確認したという。成果は、京都大学大学院情報学研究科鹿島教授との共同研究によるものであり、統計的ML分野の国際会議「AISTATS2021」にて発表された。

そしてその技術的詳細は、コーネル大学"arXiv.org"のMLタブにて公開されている。今回実現した技術について、同社は今後、回帰や教師なし学習など、他の機械学習の問題への拡張を進め、より多様な場面における人を対象とした予測を実現するための技術の確立と、応用の検討を進めるという。