授業や会議、営業活動などのオンライン化が急速かつグローバルに拡大している。そこで集中度を推定する。人の表情はそれぞれの生い立ちや文化で異なり、仕草はオンライン学習など特定のタスクに大きく依存する。一般的なAIを用いた手法では、タスクや文化的背景に特化した学習が行われる。

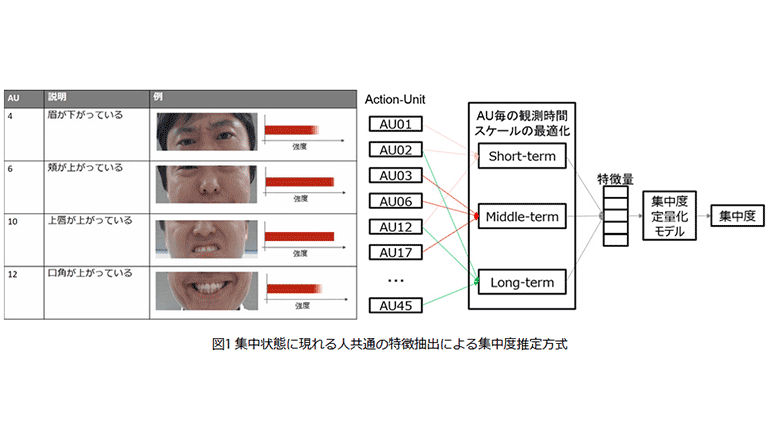

個別AIモデルの開発を要する。人がタスクに集中していれば、顔が強張ったり、目を凝らしたりして顔面に微小な変化が生じる。人類共通だと言われる概念"アクションユニット(AUs:表情筋に対応した顔面の各部位の動作単位)"を活用することで、原理的には振る舞いや文化的背景の違いによらず"集中度"を検出できるが、集中時と非集中時の微小な違いをカメラで、顔の動画データから捉えようとすると――

たとえばAUsの動きでできたしわと年齢によるしわとの区別が必要になるなど、AUs自体の精度の向上が課題になるという。富士通研究所は、人が様々なタスクを実行している時の集中度を、表情筋の動きの変化から、集中時、非集中時の顔面状態の違いとして検出することで高精度に捉え、定量化できる汎用的な集中度推定AIモデルを新たに開発した。

AUsを世界一の精度で検出する独自技術を活用して、口元に力が入る数秒程度の変化や、目を凝らして一心不乱に見つめている数十秒にわたる長期間の変化などをAUsごとに最適化された時間単位で捕捉。集中・非集中状態の違いを、各文化的背景の影響を受けにくい共通の特徴として抽出することに成功した。日米中延べ650人分のデータセットで同モデルを検証し、85%超の精度で集中を定量的に推定できることを確認した。

さらにドライブシミュレーターのデータにて、眠気による集中度低下の推定も達成し、未学習タスクへも適用できることが認められた。集中度推定AIモデルの支援により、オンラインでする各種タスクや業務の効率化、生産性アップが可能になるという。