ロボット/AI

DNNの信頼性を高めてAIの社会実装・応用へと展開する

AIが大いに注目されている。今日、深層ニューラルネットワーク(DNN)を用いた深層学習が普及。DNNはヒトの脳神経回路を模したモデルで、実社会での運用前にデータセット(DS)によってAIをトレーニングするものだ。当該トレーニングの繰り返しによって、AIは対象の特徴を「学習」できるが――

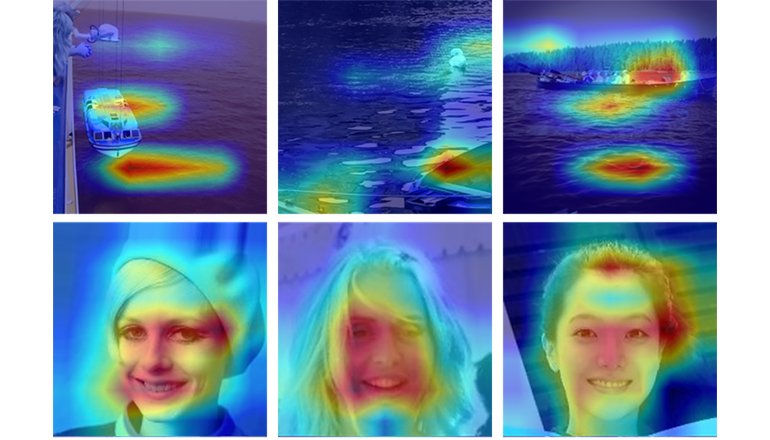

DSの設計が不適切で、対象を正確に識別できないことがある。例えば、船の画像は一般的に水面と船体を含むが、水面だけを認識し、画像に船が写っていると判断することがある。これは「共起バイアス」と呼ばれるもので、同トレーニングにおいて非常に多くの場面で直面する課題だという。

JAIST創造社会デザイン研究領域、中国吉林大学人工知能学院、東京大学大学院情報理工学系研究科の研究チームは、「共起バイアス」を取り除く新たなヒューマンインザループシステムを開発した。ユーザが画像をアノテーションすることによりDNNがROI(注目すべき領域)を調整する双方向システムも提案した。同システムでは、マウスにて画像の識別したい部分を左クリックし、無視すべき部分を右クリックする。

するとDNNは船をより正確に識別でき、共起バイアスの影響を軽減できる。アノテーションの所要画像数を減らすために今回、ガウス混合モデル(GMM)を用いた新アクティブラーニング方法も考案した。結果、アテンション誘導時間が27%削減され、学習の正確性を大幅向上させることが示された。システムがより正確で明確な判断を下せれば、ユーザがAIに対して持つ信頼度が高まり、これらのシステムをより簡単に社会応用へと展開できるようになるという。

JST・CRESTにおける「人間と情報環境の共生インタラクション基盤技術の創出と展開」及び「データ駆動型知的情報システムの理解・制御のためのインタラクション」の支援を受けて行われた、研究成果はACM IUI 2023で発表された。